Да, роботите убийци определено ще ни хванат: Нуждата от регулация на AI

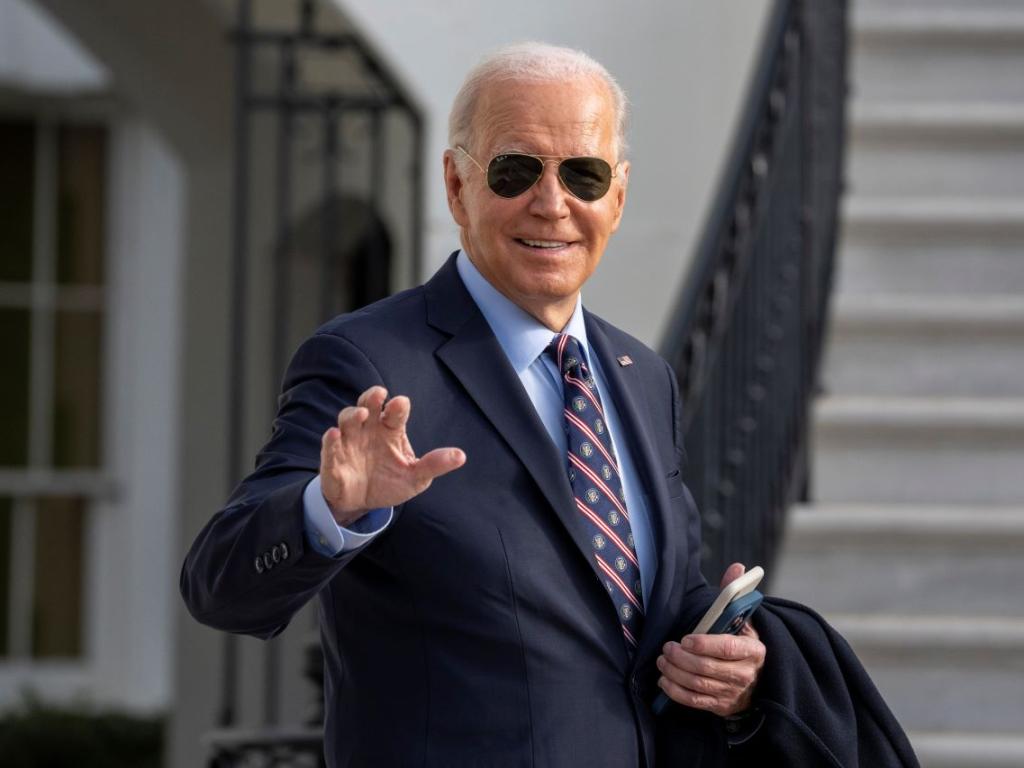

Все още има доста неща, които не знаем за robotocall в Ню Хемпшир, който се представяше за президента Джо Байдън, евентуално употребявайки технология за клониране на глас посредством изкуствен интелект.

Случаят е от 21 януари, два дни преди първичните избори, пробвайки се да обезкуражи демократите да се насочат към урните. Не е несъмнено кой стои зад позвъняването, какъв програмен продукт е употребен при основаването му или какъв брой гласоподаватели са получили сходно позвъняване.

Главната прокуратура на Ню Хемпшир проверява.

Но стана ясно едно нещо: регулаторните органи са под напън да подхващат дейности против deepfake преди изборите.

Въздействието на deepfake върху обществото – и по-специално изборите – провокира безпокойствие от години. Лесните за потребление генеративни AI принадлежности неотдавна го трансфораха от проблем в нишови области до най-голям риск за сигурността на всички места. Преди автоматизираното позвъняване на Байдън, AI deepfakes бяха употребявани в опити за спиране на изборите в Словакия и Тайван.

Конгресът взе случая под внимание.

Сенатор Майк Раундс споделя пред Politico, че до момента в който Сенатът обрисува целите си по отношение на законодателството за изкуствения разсъдък, нараства признанието, че оправянето с потреблението на изкуствен интелект в рекламите и връзките на акцията би трябвало да е отпред в листата. След deepfake наличието на Тейлър Суифт, публикувано в X предходната седмица, законодателите възобновиха апелите за спеши промени в региона на AI.

X has restored searches for Taylor Swift after temporarily blocking users from seeing some results as explicit deepfake images of the singer circulated online.

— WSLS 10 (@wsls)

Понастоящем няма федерални закони, които да не разрешават шерването или основаването на deepfake, макар че няколко законопроекта бяха препоръчани в Конгреса и някои щати одобриха закони за битка с манипулираните медии. Федералната изборна комисия също обмисля промени в разпоредбите, с цел да контролира потреблението на AI deepfakes в пропагандни материали, напомня Politico.

„ Deepfake е тест, който генеративният AI хвърли върху нас, тъй като фундаментално отстрани цялото доверие “, споделя Виджай Баласубраманян, основен изпълнителен шеф на компанията за разкриване на телефонни измами Pindrop.

„ Ако не можем да се съберем и да разберем по какъв начин да разгадаем този проблем, да, роботите убийци несъмнено ще ни заловен “, споделя Баласубраманян.

Една изключително сложна част ще бъде да разберем по какъв начин да се оправим с цялостния набор от манипулирани медии – от по-стари техники като наставяне на подправено аудио до нови генеративни усъвършенствания, подхранвани от AI, и всички хибриди сред тях, счита тя.

Според Матю Райт, който оглавява отдела по киберсигурност на Rochester Institute of Technology, robotocall, от една страна, не е доста усъвършенствано аудио подправянето.

„ Сега има налични принадлежности, които могат да свършат по-добра работа и затова да бъдат по-опасни “, споделя той.

A mysterious phone call cloned Biden's voice. Can the next one be stopped?

— POLITICO (@politico)

Разглеждайки препоръчаните федерални законопроекти и признатите държавни закони, се оказва, че няма доста неща, за които те групово са съгласни, като се стартира с това, което би трябвало да се контролира.

Законите на Калифорния и Вашингтон са ориентирани единствено към подправени изображения на политически претенденти, до момента в който Тексас и Минесота отиват по-далеч, като включват тези, основани с желанието да навредят на политически претендент или да повлияят на резултатите от изборите.

Липсва и консенсус по отношение на това какво съставлява deepfake. Някои законопроекти ясно обгръщат изображения и видео, до момента в който други обгръщат аудио.

Изглежда, че на части се движи регулирането на deepfakes. Матю Райт прави паралели с пейзажа на законодателството за неприкосновеността на персоналния живот, където мозайка от закони предлага разнообразни равнища на отбрана.

Ключов въпрос е, кой би трябвало да бъде държан виновен: снабдители на телефонни услуги, платформи, разработчици или дистрибутори на deepfakes? Как отговаряте на това в последна сметка дефинира фокуса на препоръчаните решения, показва експертът.

На федерално равнище законопроектите разпореждат отговорност на две съществени групи, споделя Мекела Пандитаратне, консултант на Програмата за народна власт на Центъра “Бренан ”.

Както при минали проблеми с модерирането на наличието, обществените медии се радват на известна отбрана от правна отговорност според федералния закон (благодарение на раздел 230 от Закона за благовъзпитание в връзките на САЩ). Двупартийният закон за Сената той предлага заблуждение под отговорност на всеки, който прави или обществено споделя deepfakes.

Случаят е от 21 януари, два дни преди първичните избори, пробвайки се да обезкуражи демократите да се насочат към урните. Не е несъмнено кой стои зад позвъняването, какъв програмен продукт е употребен при основаването му или какъв брой гласоподаватели са получили сходно позвъняване.

Главната прокуратура на Ню Хемпшир проверява.

Но стана ясно едно нещо: регулаторните органи са под напън да подхващат дейности против deepfake преди изборите.

Въздействието на deepfake върху обществото – и по-специално изборите – провокира безпокойствие от години. Лесните за потребление генеративни AI принадлежности неотдавна го трансфораха от проблем в нишови области до най-голям риск за сигурността на всички места. Преди автоматизираното позвъняване на Байдън, AI deepfakes бяха употребявани в опити за спиране на изборите в Словакия и Тайван.

Конгресът взе случая под внимание.

Сенатор Майк Раундс споделя пред Politico, че до момента в който Сенатът обрисува целите си по отношение на законодателството за изкуствения разсъдък, нараства признанието, че оправянето с потреблението на изкуствен интелект в рекламите и връзките на акцията би трябвало да е отпред в листата. След deepfake наличието на Тейлър Суифт, публикувано в X предходната седмица, законодателите възобновиха апелите за спеши промени в региона на AI.

X has restored searches for Taylor Swift after temporarily blocking users from seeing some results as explicit deepfake images of the singer circulated online.

— WSLS 10 (@wsls)

Понастоящем няма федерални закони, които да не разрешават шерването или основаването на deepfake, макар че няколко законопроекта бяха препоръчани в Конгреса и някои щати одобриха закони за битка с манипулираните медии. Федералната изборна комисия също обмисля промени в разпоредбите, с цел да контролира потреблението на AI deepfakes в пропагандни материали, напомня Politico.

„ Deepfake е тест, който генеративният AI хвърли върху нас, тъй като фундаментално отстрани цялото доверие “, споделя Виджай Баласубраманян, основен изпълнителен шеф на компанията за разкриване на телефонни измами Pindrop.

„ Ако не можем да се съберем и да разберем по какъв начин да разгадаем този проблем, да, роботите убийци несъмнено ще ни заловен “, споделя Баласубраманян.

Една изключително сложна част ще бъде да разберем по какъв начин да се оправим с цялостния набор от манипулирани медии – от по-стари техники като наставяне на подправено аудио до нови генеративни усъвършенствания, подхранвани от AI, и всички хибриди сред тях, счита тя.

Според Матю Райт, който оглавява отдела по киберсигурност на Rochester Institute of Technology, robotocall, от една страна, не е доста усъвършенствано аудио подправянето.

„ Сега има налични принадлежности, които могат да свършат по-добра работа и затова да бъдат по-опасни “, споделя той.

A mysterious phone call cloned Biden's voice. Can the next one be stopped?

— POLITICO (@politico)

Разглеждайки препоръчаните федерални законопроекти и признатите държавни закони, се оказва, че няма доста неща, за които те групово са съгласни, като се стартира с това, което би трябвало да се контролира.

Законите на Калифорния и Вашингтон са ориентирани единствено към подправени изображения на политически претенденти, до момента в който Тексас и Минесота отиват по-далеч, като включват тези, основани с желанието да навредят на политически претендент или да повлияят на резултатите от изборите.

Липсва и консенсус по отношение на това какво съставлява deepfake. Някои законопроекти ясно обгръщат изображения и видео, до момента в който други обгръщат аудио.

Изглежда, че на части се движи регулирането на deepfakes. Матю Райт прави паралели с пейзажа на законодателството за неприкосновеността на персоналния живот, където мозайка от закони предлага разнообразни равнища на отбрана.

Ключов въпрос е, кой би трябвало да бъде държан виновен: снабдители на телефонни услуги, платформи, разработчици или дистрибутори на deepfakes? Как отговаряте на това в последна сметка дефинира фокуса на препоръчаните решения, показва експертът.

На федерално равнище законопроектите разпореждат отговорност на две съществени групи, споделя Мекела Пандитаратне, консултант на Програмата за народна власт на Центъра “Бренан ”.

Както при минали проблеми с модерирането на наличието, обществените медии се радват на известна отбрана от правна отговорност според федералния закон (благодарение на раздел 230 от Закона за благовъзпитание в връзките на САЩ). Двупартийният закон за Сената той предлага заблуждение под отговорност на всеки, който прави или обществено споделя deepfakes.

Източник: vesti.bg

КОМЕНТАРИ