Как да се доверяваме на изкуствения интелект, когато не знаем какво мисли?

Бруталната истина да бъдеш човек е, че в никакъв случай не можеш да узнаеш мислите на никой различен с изключение на себе си. Единственото схващане, до което имаме открит достъп, е нашето лично и всичко, което знаем за другите, в това число най-близките и най-скъпите ни, е това, което можем, спекулативно да заключим от техните думи и дейности или от това, което решат да разкрият посредством пояснение.

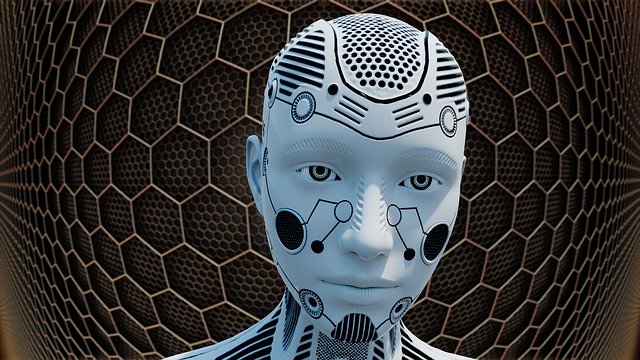

И по този начин, в свят, все по-населен от безчовечен сътрудници, като роботи и изкуствен интелект, непознаваемостта на мозъка се трансформира в нов вид тревога. Въпреки че можем да заключим, че мисловните процеси и мотивациите на другите би трябвало да се съгласуват значително с нашите лични с помощта на нашата споделена биология, няма такова умствено доближаване с машините.

Как можем да се доверим на изкуствения разсъдък (AI), в случай че не знаем какво мисли?

Тази тревога е била източник на ентусиазъм за редица писатели на научна фантастика през годините. Това е литература на смяната за обществата наситени с технологии и постоянно ни оказва помощ да изследваме продължаващия развой на взаимна промяна. Докато развиваме и усъвършенстваме технологията, тя стартира да предефинира нашия метод на живот и мислене, което от своя страна поражда нови софтуерни стремежи.

Както се аргументира американският книжовен критик Фредерик Джеймсън, функционалността на научната фантастика е „ да не ни дава„ облици “на бъдещето…, а по-скоро да трансформира и преструктурира нашия опит от сегашното. “

Още от първите дни на научната фантастика мотивациите и аргументите, които стоят зад действието на роботите, са източник на неустановеност. Айзък Азимов в доста от своите къси разкази изследва пояснения за държанието на машината, постоянно ненапълно песимистично. Важен фокус на сходни истории е концепцията, че самите роботи могат да дадат на хората пояснение за своето мислене и държание. Тези пояснения са жизненоважни за поощряване на доверието.

Пример за връзката сред машинните пояснения и човешкото доверие е даден от Робин Р Мърфи от Тексаския университет A&M в неотдавнашна публикация в списание Science Robotics. Тя показва история от 1972 година, наречена Long Shot от плодовития американски публицист на научна фантастика Вернор Винг.

В историята галактическият транспортен съд на пръв взор наподобява некоректен, като се отклонява от открития проект на полета, единствено с цел да изясни по-късно, че заради сензитивна към времето обстановка, корабът не съумява да се съветва първо с човешките надзорници. При този сюжет недоверието се разсейва от робота, който е в положение да изясни дейностите си.

Както постоянно се случва, връзката сред научната фантастика и науката е дълбока. Също по този начин в Science Robotics, екип от интернационалните откриватели на изкуствения разсъдък, управителен от Дейвид Ганинг от Агенцията за напреднали научни планове в региона на защитата на Съединени американски щати (DARPA), предлага явен доклад за това, което е известно в актуалните проучвания на AI, като „ разбираем изкуствен интелект “ или XAI.

Според създателите „ XAI система би трябвало да може да изясни своите благоприятни условия и разбирания; да изясни какво е направила, какво прави в този момент и какво ще се случи след това; както и да разкрие значимата информация, въз основа на която работи. “

Това е изключително значимо в този момент, защото огромна част от държанието на ИИ се основава на метода, по който машините се учат, а машинното образование постоянно е сложен и непрогледен развой. Целта на XAI, пишат създателите е, че в свят, цялостен с ИИ, „ обясненията са от значително значение потребителите да схванат, да се доверят и дейно да ръководят тези нови, изкуствено интелигентни сътрудници. “

Интересното е, че Ганинг и сътрудниците му показват като проблем това, че най-ефективните способи, посредством които машините учат, постоянно са минимум обясними, а най-обяснимите детайли на машинното взимане на решения постоянно са минимум точните.

Това води до огромно проучване по тематиката на XAI в неотдавнашния брой на Science Robotics, по който както Мърфи, по този начин и екипът на Ганинг дебатират.

Американски откриватели, водени от Марк Едмондс, Фън Гао и техни сътрудници от Калифорнийския университет в Лос Анджелис, регистрират заключенията от своето пробно изследване на метода, по който да се увеличи доверието на хората към роботите и изкуствения разсъдък.

XAI е в начален етап на развиване, защото множеството откриватели са по-фокусирани върху осъществяването на дилемите сложени на AI, в сравнение с върху приемането на пояснение за това осъществяване. Това е възпрепятствано и от другите равнища на обяснителност във връзка с другите тактики за машинно образование, от които има два съществени образеца: алегоричен разбор на задания, като дърво за решения, и машинно образование въз основа на дълбоки невронни мрежи.

Статия от Стефан Флайшфресер (Stephen Fleischfresser), оповестена в списание Cosmos.