Ще бъде ли успешна регулацията на изкуствения интелект в Европа?

" Аз съм ChatGPT, огромен модел за обработка на естествения език, създаден от OpenAI. Моята цел е да оказвам помощ на хората като давам отговор на техни въпроси и отпущам информация в разнообразни области ".

Така суперпопулярният в последно време ChatGPT дава отговор на въпроса " Кой си ти? " ChatGPT е образец за едно от приложенията на изкуствения разсъдък (ИИ). Тази цялост от технологии ни предлага големи благоприятни условия във всички сфери на живота. Възможности, които в някои случаи все звучат като научна фантастика.

" Макар че разполагам с богат набор от познания, значимо е да се означи, че аз не владея лично схващане или съзнание, а просто проучвам текста и отпущам отговори въз основа на образованието си ", споделя още той.

Изкуственият разсъдък може да донесе доста изгоди – по-добро здравно обслужване, по-безопасен и по-чист превоз, по-ефективно произвеждане, по-устойчиво ползване на сила.

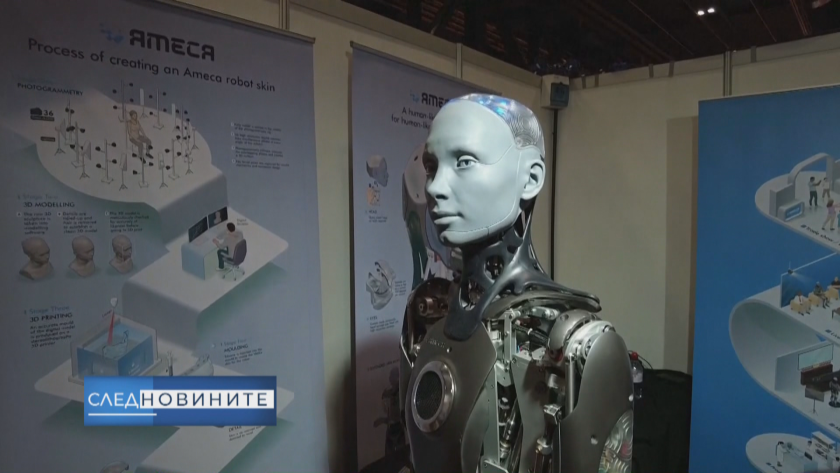

" Най-кошмарният сюжет, който мога да си показва, обвързван с изкуствения разсъдък и роботиката, е свят, в който роботите са станали толкоз мощни, че са в положение да управляват или манипулират хората без тяхно познание. Това може да докара до общество, в което правата на хората към този момент не се зачитат ", споделя хуманоидният робот Амека, основан през 2021 година

Това осъзнава освен Амека. Все повече се чуват и разтревожени гласове, които питат дали в избран миг машините ще спрат да се нуждаят от хората и може ли ИИ да се трансформира в призрачен сън за човечеството. Хуманоидният робот също има мнение по тематиката.

" Затова е значимо да сме наясно с евентуалните опасности и рискове, свързани с ИИ и роботиката. Трябва да предприемем стъпки в този момент, с цел да подсигуряваме, че тези технологии се употребяват отговорно, с цел да избегнем всевъзможни отрицателни последствия в бъдеще. "

Светът се нуждае допустимо най-бързо от правила, които да контролират изкуствения разсъдък и да му слагат граници. Европа е напът за одобри.

" Изкуственият разсъдък е прекомерно значим, с цел да не се контролира. Той е прекомерно значим, с цел да се контролира неприятно. Един добър закон, към който всички да се обединим допустимо най-скоро, би трябвало да бъде обща цел. И несъмнено, че се нуждаем от рационални правоприлагащи ограничения. Имаме потребност от пълномощия, които този закон ще ни даде на процедура, с цел да бъдат хората в сигурност ", споделя Маргарете Вестагер - зам.-председател на Европейската комисия.

Европейският парламент утвърди своята формулировка за ИИ и раздели областите на използването му съгласно степенна на риск. Подходът е индивидът, а не машините са бъдат в центъра на вниманието . Европа обръща огромно внимание на етичните въпроси, с цел да не се стига да злоупотреби с изкуствен интелект, нарушение на персонално пространство и човешки права.

Българска национална телевизия: Какви могат да бъдат следствията?

Ева Майдел - евродепутат от ЕНП, докладчик от Комисията по промишленост и нововъведения: Това, от което доста жители се тормозят е, когато изкуственият разсъдък взима решения, вместо да ги взима да вземем за пример един банков чиновник или човек, работещ в университет, който да реши дали да одобри един студент в избрана компетентност. Т.е., в случай че на един жител му бъде отхвърлен заем от банката и това решение е взето от изкуствен интелект, ние вършим по този начин, че този закон да квалифицира тази активност на ИИ като високорискова и жителят, в случай че не е удовлетворен от решението, да може да разбере въз основата на какво то е взето. Т.е., в случай че сте компания, която развива този тип изкуствен интелект, би трябвало да може да отговорите на този въпрос, да имате задоволително документи и задоволително бистрота.

Освен банковият бранш и образованието, различен високорисков бранш, който употребява системи с ИИ, е биометричната идентификация в действително време на публични места. През последните години системи, които правят лицево различаване, се ползват всеобщо: работодатели ги употребяват, с цел да следят служащите си, управляващите, с цел да наблюдават ентусиастите по стадионите или идващи по летищата. Биометричната идентификация, която употребява изкуствен интелект, може да разпознава физически, поведенчески и психически характерности на индивида, може да следи придвижването на очите, изражението на лицето, гласа, даже походката, сърдечния темп или кръвното налягане. Така се определяне на самоличността на обещано лице въз основата на сравняване на биометричните данни с тези на голям брой други, съхранени в база данни. Обикновено от следения не се желае единодушие лицето не дава единодушие за това.

" Въведохме нещо, което го нямаше в първичното предложение, а точно даваме опция на жителите или на консуматори да възразяват, да се оплакват, ако не се усещат добре поради потреблението на някаква технология ", уточни Драгош Тудораче - румънски евродепутат от Обнови Европа и докладчик по тематиката

Според Екологичен потенциал биометричната идентификация накърнява правата и свободите на хората и може да остави у обществото чувство за непрекъснато наблюдаване и безконтролна власт на страната. Евродепутатите дават за образец Китай и по този начин наречената обществена кредитна система - високотехнолотична стратегия, която управляващите употребяват за наблюдаване, оценка и постоянно ограничение на правата на хората. Затова Екологичен потенциал предлага изцяло да се забрани потреблението на ИИ за лицево различаване и следене . Както и биометрично категоризиране по пол, възраст, цвят на косата, цвят на очите, татуировки, етнически или обществен генезис, език или вяра. Това значи, че системите не би трябвало да се настройват да разпознават единствено избрана група, да вземем за пример чернокожи хора.

" Имахме разминаване до последната минута в Народното събрание по тази точка за ясна възбрана за биометрична идентификация в действително време. Някои желаеха да политизират този въпрос и да го трансфорат в инструмент за агитация, само че не съумяха. Парламентът одобри ясна защитна мярка, с цел да се избегне всеки риск от всеобщо наблюдаване и в това време да запазим опцията с идентификация, която не в действително време да преследваме нарушителите в обществото ", сподели Брано Бенифей - италиански евродепутат от Групата на социалистите, и докладчик по тематиката.

Европейската национална партия счита, че лицевото различаване в действително време въпреки всичко може да се употребява в няколко случая , само че към този момент това предложение не се приема от останалите.

" Трябва да можем да използваме изкуствен интелект или лицево различаване единствено в случаите, когато приказваме за терористична офанзива или когато има отвлечени деца. ЕНП доста ясно отстоява позицията, че в тези два случая би трябвало да имаме опция нашите правоохранителни системи да могат да употребяват изкуствения разсъдък, изключително в първите моменти при такива случаи ", разяснява Ева Майдел.

Екологичен потенциал не разрешава и системите с ИИ, ориентирани към установяване на страсти, изражения на лицето, придвижвания, периодичност на пулса или гласа . Различни компании към този момент оферират такива технологии, които се употребяват от управляващите по границите да вземем за пример, на работното място, при изявление за работа или в просветителни институции. Европа също по този начин не желае и записите от видеонаблюдение и лицеви изображения да се резервират и да се основават бази данни. Изкуственият разсъдък може да бъде рисков и за разпространяването на дезинформация , само че в това време е нужен за по-бързото ѝ разкриване.

" Въпросът за дезинформацията е извънредно значим. Това не е ново разбиране, само че в последните няколко години обществените мрежи и платформи направиха по този начин, че дезинформацията да се популяризира по-бързо. Това, което ИИ способства сега към тази полемика е, че можеш доста по-бързо да генерираш наличие, което е основано от ИИ ", разяснява Ева Майдел.

Преди изборите е доста значимо системите с изкуствен интелект да бъдат надеждни. Създателите им също осъзнават това.

" Това е една от областите, за които съм най-загрижен: общата дарба на тези модели да манипулират, да убеждават, да дават един към един, разбирате ли, интерактивна дезинформация. В подтекст на избори и предвид на това, че тези модели стават все по-добри, разбирам, че това е основава безпокойствие ", сподели Сам Алтман - шеф на OpenAI.

Европа ще упорства акциите, които генерират наличие посредством изкуствен интелект , каквато система е и ChatGPT, да бъдат оптимално транспарантни за своите логаритми и наложително да означават, че наличието е основано от машина .

" Компаниите, които употребяват изкуствен интелект в своите услуги, като Bing на Microsoft и Bard на Гугъл би трябвало да обезпечат гаранции, че тези услуги няма да се използат от злонамерени хора за основаването на подправени вести. Компаниите, които имат услуги, разпространяващи наличие, основано от изкуствен интелект, би трябвало да основат технологии за ясното му отбелязване и различаване от потребителите. Нашата съществена задача е да пазиме свободата на словото, само че когато става думи за продуктите на изкуствения разсъдък, аз не виждам никакво съображение машините да имат право на независимост на словото ", уточни Вера Йоурова - зам.-председател на Европейската комисия, отговарящ за европейските полезности.

Международните компании, които не съблюдават разпоредбите в Европейски Съюз, ще бъдат глобявани . Някои политици се тормозят, че прекомерно строгите правила в Европа могат за изгонят софтуерните компании.

" Ситуацията е сериозна. Някои от стартъпите или цифровата промишленост може да си кажат, че става прекомерно комплицирано и да изоставен Европа. Има възможност това да се случи. Надявам се въпреки всичко да не го вършат, а и ще се опитаме да реализираме по-добър резултат по време на триалозите. Няма гаранции, че това ще стане, само че ще се опитаме ", счита Аксел Фос - евродепутат от ЕНП, Германия.

Всички компании, които желаят да продават продуктите си тук, по този начин или другояче ще би трябвало да дават отговор на новите регулации. Според Аксел Фос Екологичен потенциал се управлява в дейностите си от страхове - нещо, което в никакъв случай не води до напредък.

За да се трансфорат в европейски закон, който ще важи за всички страни от общността, новите правила за изкуствения разсъдък ще би трябвало да бъдат утвърдени от страните и от Комисията. В Брюксел се надяват законът да е реалност през февруари и да влезе в действие след двегодишен временен интервал.

Така суперпопулярният в последно време ChatGPT дава отговор на въпроса " Кой си ти? " ChatGPT е образец за едно от приложенията на изкуствения разсъдък (ИИ). Тази цялост от технологии ни предлага големи благоприятни условия във всички сфери на живота. Възможности, които в някои случаи все звучат като научна фантастика.

" Макар че разполагам с богат набор от познания, значимо е да се означи, че аз не владея лично схващане или съзнание, а просто проучвам текста и отпущам отговори въз основа на образованието си ", споделя още той.

Изкуственият разсъдък може да донесе доста изгоди – по-добро здравно обслужване, по-безопасен и по-чист превоз, по-ефективно произвеждане, по-устойчиво ползване на сила.

" Най-кошмарният сюжет, който мога да си показва, обвързван с изкуствения разсъдък и роботиката, е свят, в който роботите са станали толкоз мощни, че са в положение да управляват или манипулират хората без тяхно познание. Това може да докара до общество, в което правата на хората към този момент не се зачитат ", споделя хуманоидният робот Амека, основан през 2021 година

Това осъзнава освен Амека. Все повече се чуват и разтревожени гласове, които питат дали в избран миг машините ще спрат да се нуждаят от хората и може ли ИИ да се трансформира в призрачен сън за човечеството. Хуманоидният робот също има мнение по тематиката.

" Затова е значимо да сме наясно с евентуалните опасности и рискове, свързани с ИИ и роботиката. Трябва да предприемем стъпки в този момент, с цел да подсигуряваме, че тези технологии се употребяват отговорно, с цел да избегнем всевъзможни отрицателни последствия в бъдеще. "

Светът се нуждае допустимо най-бързо от правила, които да контролират изкуствения разсъдък и да му слагат граници. Европа е напът за одобри.

" Изкуственият разсъдък е прекомерно значим, с цел да не се контролира. Той е прекомерно значим, с цел да се контролира неприятно. Един добър закон, към който всички да се обединим допустимо най-скоро, би трябвало да бъде обща цел. И несъмнено, че се нуждаем от рационални правоприлагащи ограничения. Имаме потребност от пълномощия, които този закон ще ни даде на процедура, с цел да бъдат хората в сигурност ", споделя Маргарете Вестагер - зам.-председател на Европейската комисия.

Европейският парламент утвърди своята формулировка за ИИ и раздели областите на използването му съгласно степенна на риск. Подходът е индивидът, а не машините са бъдат в центъра на вниманието . Европа обръща огромно внимание на етичните въпроси, с цел да не се стига да злоупотреби с изкуствен интелект, нарушение на персонално пространство и човешки права.

Българска национална телевизия: Какви могат да бъдат следствията?

Ева Майдел - евродепутат от ЕНП, докладчик от Комисията по промишленост и нововъведения: Това, от което доста жители се тормозят е, когато изкуственият разсъдък взима решения, вместо да ги взима да вземем за пример един банков чиновник или човек, работещ в университет, който да реши дали да одобри един студент в избрана компетентност. Т.е., в случай че на един жител му бъде отхвърлен заем от банката и това решение е взето от изкуствен интелект, ние вършим по този начин, че този закон да квалифицира тази активност на ИИ като високорискова и жителят, в случай че не е удовлетворен от решението, да може да разбере въз основата на какво то е взето. Т.е., в случай че сте компания, която развива този тип изкуствен интелект, би трябвало да може да отговорите на този въпрос, да имате задоволително документи и задоволително бистрота.

Освен банковият бранш и образованието, различен високорисков бранш, който употребява системи с ИИ, е биометричната идентификация в действително време на публични места. През последните години системи, които правят лицево различаване, се ползват всеобщо: работодатели ги употребяват, с цел да следят служащите си, управляващите, с цел да наблюдават ентусиастите по стадионите или идващи по летищата. Биометричната идентификация, която употребява изкуствен интелект, може да разпознава физически, поведенчески и психически характерности на индивида, може да следи придвижването на очите, изражението на лицето, гласа, даже походката, сърдечния темп или кръвното налягане. Така се определяне на самоличността на обещано лице въз основата на сравняване на биометричните данни с тези на голям брой други, съхранени в база данни. Обикновено от следения не се желае единодушие лицето не дава единодушие за това.

" Въведохме нещо, което го нямаше в първичното предложение, а точно даваме опция на жителите или на консуматори да възразяват, да се оплакват, ако не се усещат добре поради потреблението на някаква технология ", уточни Драгош Тудораче - румънски евродепутат от Обнови Европа и докладчик по тематиката

Според Екологичен потенциал биометричната идентификация накърнява правата и свободите на хората и може да остави у обществото чувство за непрекъснато наблюдаване и безконтролна власт на страната. Евродепутатите дават за образец Китай и по този начин наречената обществена кредитна система - високотехнолотична стратегия, която управляващите употребяват за наблюдаване, оценка и постоянно ограничение на правата на хората. Затова Екологичен потенциал предлага изцяло да се забрани потреблението на ИИ за лицево различаване и следене . Както и биометрично категоризиране по пол, възраст, цвят на косата, цвят на очите, татуировки, етнически или обществен генезис, език или вяра. Това значи, че системите не би трябвало да се настройват да разпознават единствено избрана група, да вземем за пример чернокожи хора.

" Имахме разминаване до последната минута в Народното събрание по тази точка за ясна възбрана за биометрична идентификация в действително време. Някои желаеха да политизират този въпрос и да го трансфорат в инструмент за агитация, само че не съумяха. Парламентът одобри ясна защитна мярка, с цел да се избегне всеки риск от всеобщо наблюдаване и в това време да запазим опцията с идентификация, която не в действително време да преследваме нарушителите в обществото ", сподели Брано Бенифей - италиански евродепутат от Групата на социалистите, и докладчик по тематиката.

Европейската национална партия счита, че лицевото различаване в действително време въпреки всичко може да се употребява в няколко случая , само че към този момент това предложение не се приема от останалите.

" Трябва да можем да използваме изкуствен интелект или лицево различаване единствено в случаите, когато приказваме за терористична офанзива или когато има отвлечени деца. ЕНП доста ясно отстоява позицията, че в тези два случая би трябвало да имаме опция нашите правоохранителни системи да могат да употребяват изкуствения разсъдък, изключително в първите моменти при такива случаи ", разяснява Ева Майдел.

Екологичен потенциал не разрешава и системите с ИИ, ориентирани към установяване на страсти, изражения на лицето, придвижвания, периодичност на пулса или гласа . Различни компании към този момент оферират такива технологии, които се употребяват от управляващите по границите да вземем за пример, на работното място, при изявление за работа или в просветителни институции. Европа също по този начин не желае и записите от видеонаблюдение и лицеви изображения да се резервират и да се основават бази данни. Изкуственият разсъдък може да бъде рисков и за разпространяването на дезинформация , само че в това време е нужен за по-бързото ѝ разкриване.

" Въпросът за дезинформацията е извънредно значим. Това не е ново разбиране, само че в последните няколко години обществените мрежи и платформи направиха по този начин, че дезинформацията да се популяризира по-бързо. Това, което ИИ способства сега към тази полемика е, че можеш доста по-бързо да генерираш наличие, което е основано от ИИ ", разяснява Ева Майдел.

Преди изборите е доста значимо системите с изкуствен интелект да бъдат надеждни. Създателите им също осъзнават това.

" Това е една от областите, за които съм най-загрижен: общата дарба на тези модели да манипулират, да убеждават, да дават един към един, разбирате ли, интерактивна дезинформация. В подтекст на избори и предвид на това, че тези модели стават все по-добри, разбирам, че това е основава безпокойствие ", сподели Сам Алтман - шеф на OpenAI.

Европа ще упорства акциите, които генерират наличие посредством изкуствен интелект , каквато система е и ChatGPT, да бъдат оптимално транспарантни за своите логаритми и наложително да означават, че наличието е основано от машина .

" Компаниите, които употребяват изкуствен интелект в своите услуги, като Bing на Microsoft и Bard на Гугъл би трябвало да обезпечат гаранции, че тези услуги няма да се използат от злонамерени хора за основаването на подправени вести. Компаниите, които имат услуги, разпространяващи наличие, основано от изкуствен интелект, би трябвало да основат технологии за ясното му отбелязване и различаване от потребителите. Нашата съществена задача е да пазиме свободата на словото, само че когато става думи за продуктите на изкуствения разсъдък, аз не виждам никакво съображение машините да имат право на независимост на словото ", уточни Вера Йоурова - зам.-председател на Европейската комисия, отговарящ за европейските полезности.

Международните компании, които не съблюдават разпоредбите в Европейски Съюз, ще бъдат глобявани . Някои политици се тормозят, че прекомерно строгите правила в Европа могат за изгонят софтуерните компании.

" Ситуацията е сериозна. Някои от стартъпите или цифровата промишленост може да си кажат, че става прекомерно комплицирано и да изоставен Европа. Има възможност това да се случи. Надявам се въпреки всичко да не го вършат, а и ще се опитаме да реализираме по-добър резултат по време на триалозите. Няма гаранции, че това ще стане, само че ще се опитаме ", счита Аксел Фос - евродепутат от ЕНП, Германия.

Всички компании, които желаят да продават продуктите си тук, по този начин или другояче ще би трябвало да дават отговор на новите регулации. Според Аксел Фос Екологичен потенциал се управлява в дейностите си от страхове - нещо, което в никакъв случай не води до напредък.

За да се трансфорат в европейски закон, който ще важи за всички страни от общността, новите правила за изкуствения разсъдък ще би трябвало да бъдат утвърдени от страните и от Комисията. В Брюксел се надяват законът да е реалност през февруари и да влезе в действие след двегодишен временен интервал.

Източник: bnt.bg

КОМЕНТАРИ